Shanghai Artificial Intelligence Laboratory, China · 成立于 2020

以人工智能

赋能医学与健康

打造世界领先的 AI 模型、智能体与工具,推动精准医学与大健康的普惠落地,让高水平的诊断、治疗与科学发现惠及每一位医生、每一位患者、每一个社区。

Shanghai Artificial Intelligence Laboratory, China

向下滚动

30+

学术论文

20+

在组成员

10,000+

引用次数

我们的北极星

让最好的医学与健康不再被地域、机构或身份所分割—— 让 AI 把每一位优秀医生的那双手, 伸向地球上的每一个人。

我们的使命。在本十年内,交付真正通用的医学 AI—— 基础模型、多智能体系统与开放工具链—— 让它们在真实医院、真实诊所与真实社区的日常健康中,带来可衡量的改变。

01

1,800+已归档数据集

100B+tokens 语料

3.61亿分割掩码

医学数据基础设施

夯实基础:大规模医学数据平台建设

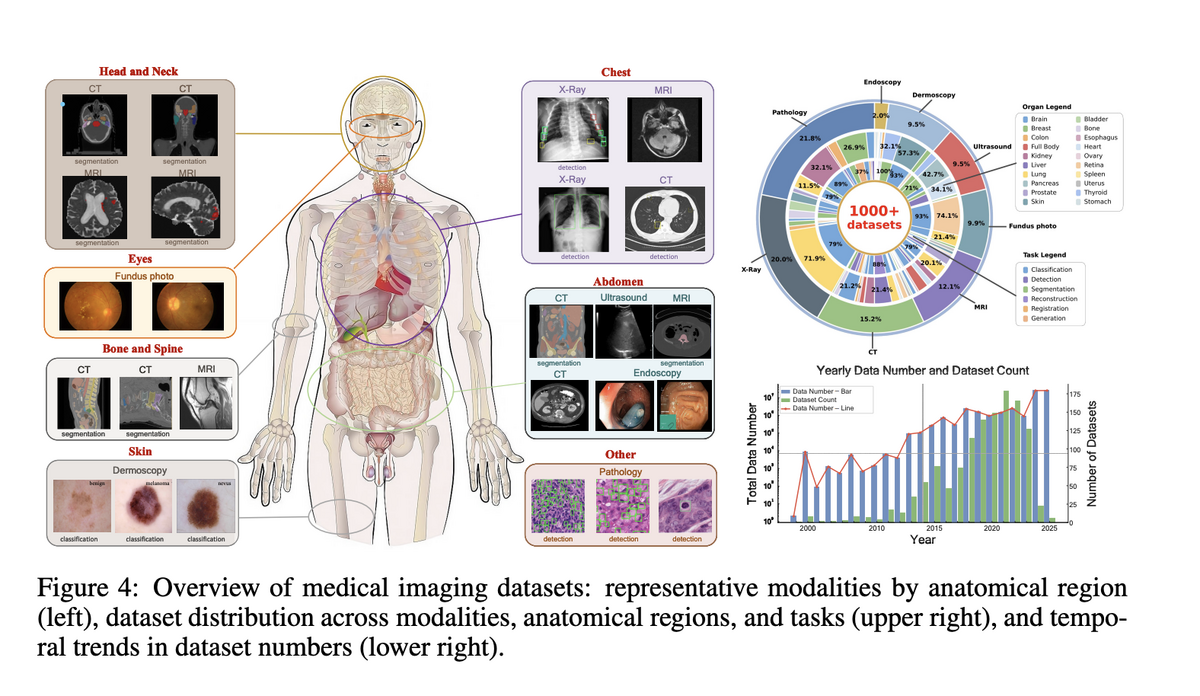

我们构建了驱动世界领先医学 AI 的数据基础设施。Project Imaging-X 通过元数据驱动融合范式(MDFP),

系统整合 1,000+ 个开放医学影像数据集,并搭建交互式发现门户。

我们的私有语料库涵盖超 100B tokens 生物医学文本、过亿医学图像及 3.61 亿分割掩码,

为跨模态、跨任务、跨疾病的通用基础模型训练提供坚实支撑。

Project Imaging-X

元数据驱动融合

探索 Imaging-X 项目 →

02

550万图文对

18临床科室

38影像模态

医学多模态大模型

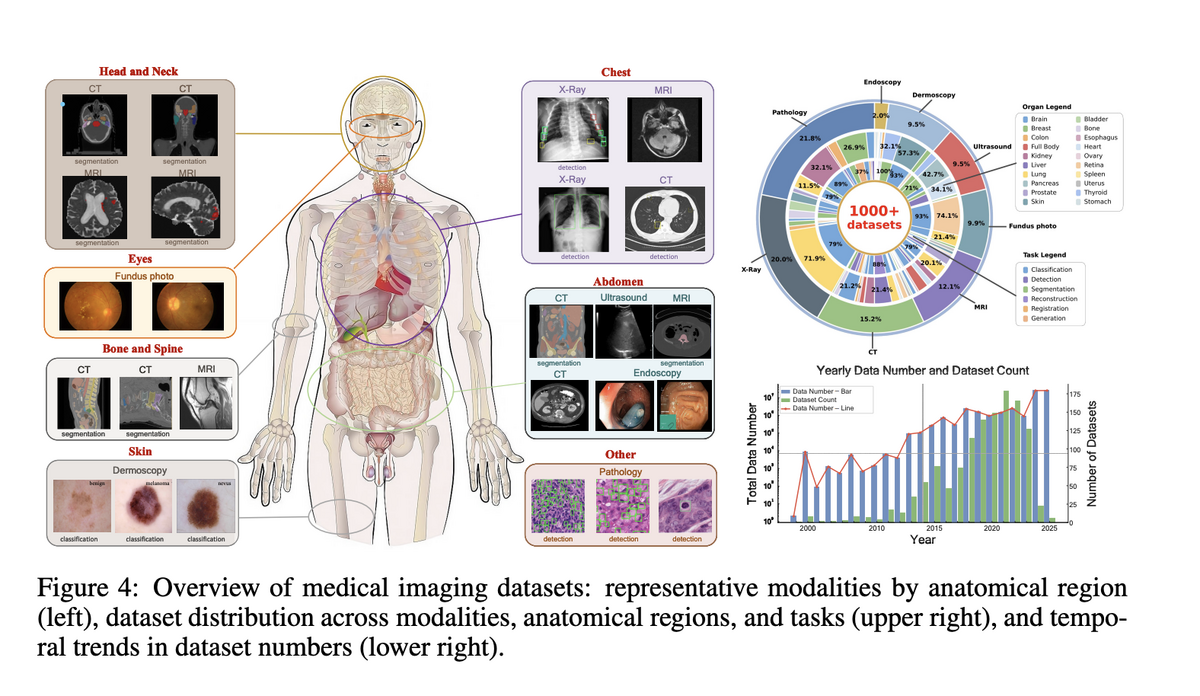

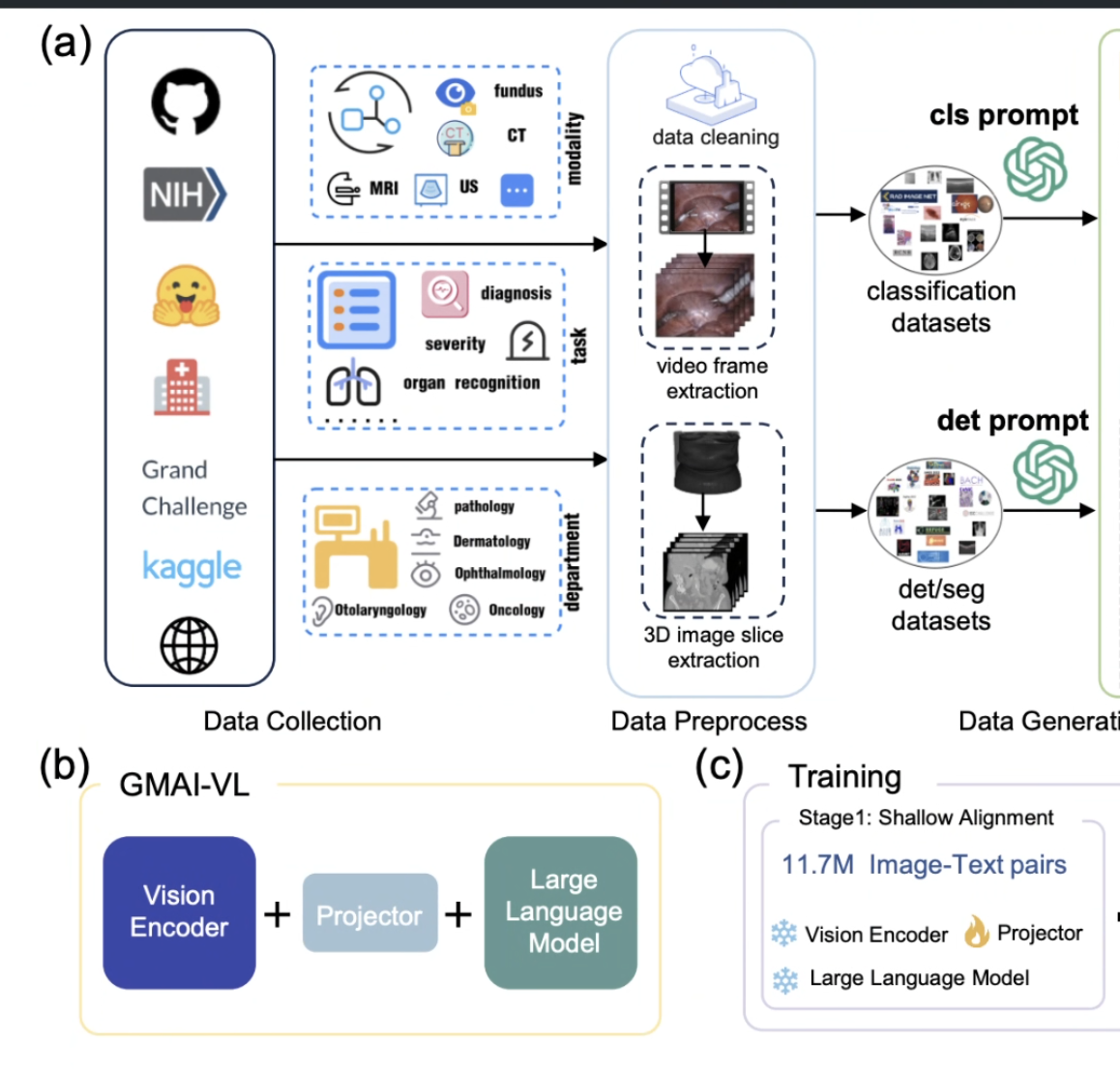

通用医学视觉语言模型:GMAI-VL 与垂类突破

我们打造世界领先的医学多模态大模型。GMAI-VL 基于涵盖 18 个临床科室的 550 万图文对训练,

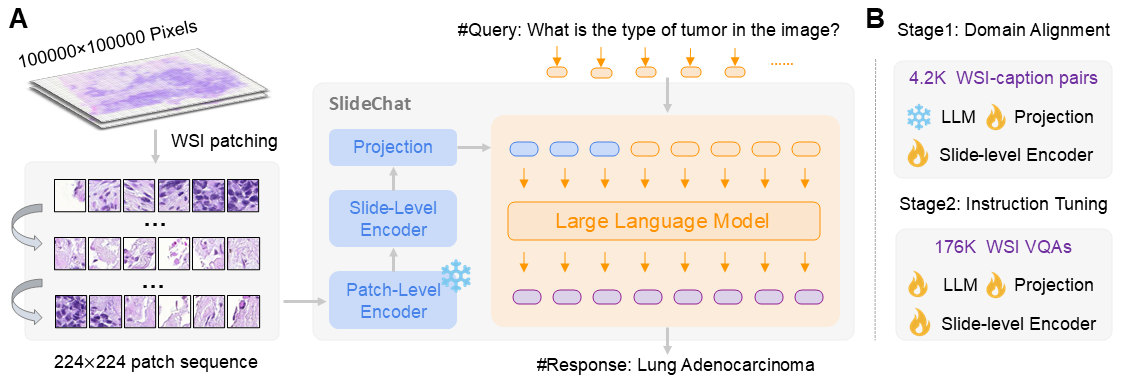

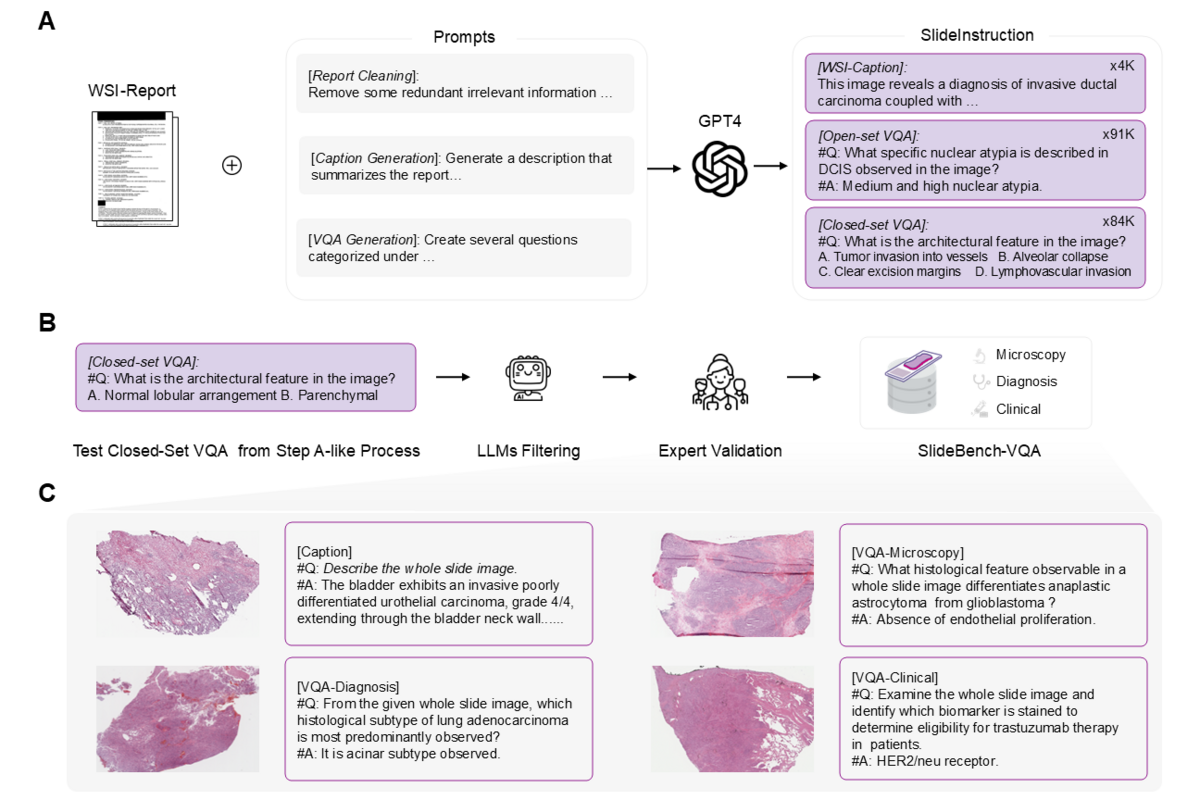

在医学 VQA 和诊断推理任务上达到并刷新 SOTA 水平。SlideChat 是首个能直接理解千兆像素

全切片病理图像的视觉-语言助手(CVPR 2025)。GMAI-VL-R1 引入强化学习,

在八种影像模态上平均准确率提升近 30%,超越参数量大 36 倍的基线模型。

GMAI-VL

GMAI-VL-5.5M

GMAI-VL-R1

GMAI-MMBench

探索 GMAI-VL →

03

14.3万三维掩码(SA-Med3D)

247解剖类别

SOTA三维分割

医学图像分割

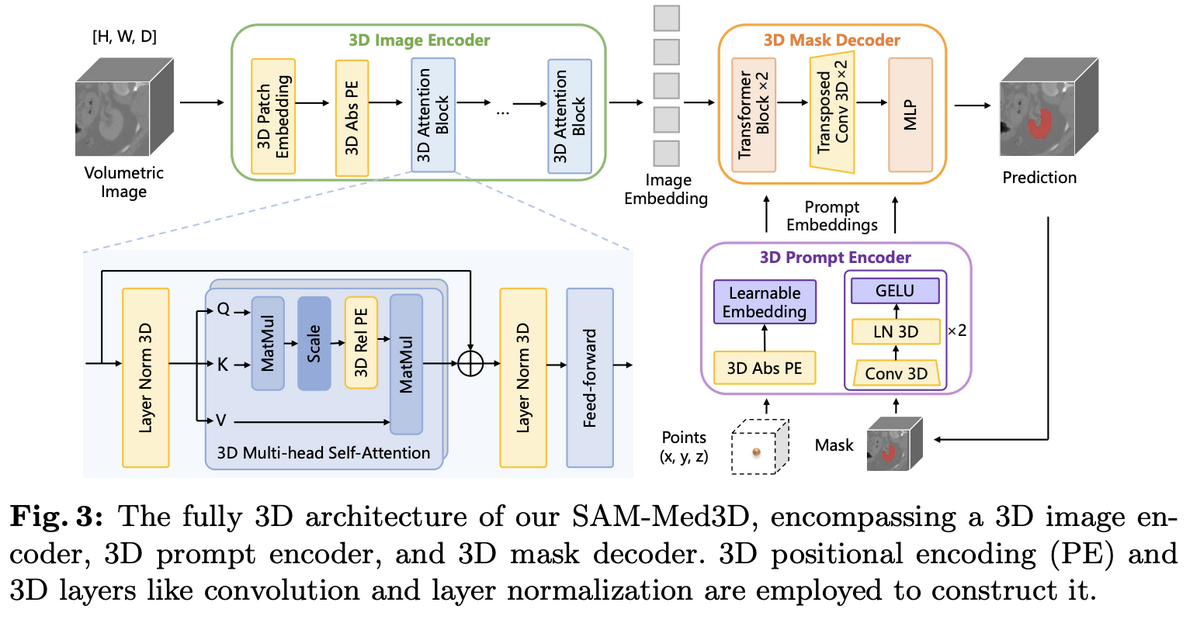

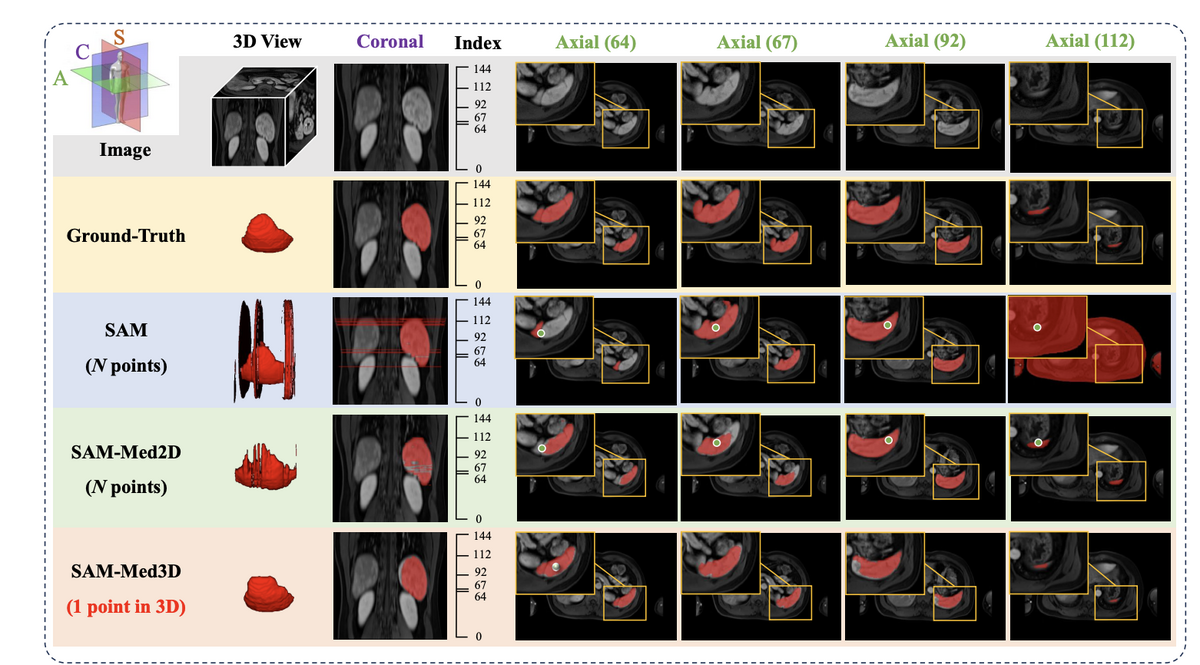

分割一切:SAM-Med2D 与 SAM-Med3D 医学通用分割

我们将 Segment Anything Model 深度适配至医学领域,在 14 种影像模态、247 类解剖与病灶

目标上实现通用可提示分割。SAM-Med2D 基于 SA-Med2D-20M 覆盖二维切片场景;SAM-Med3D

采用全原生三维架构,在 SA-Med3D-140K(2.2 万体积、14.3 万掩码)上训练,仅需单个三维

点提示即可实现超过 SAM 60% 的 Dice 提升,真正实现"分割一切"。

SAM-Med3D

SAM-Med2D

SA-Med3D-140K

交互式分割

探索 SAM-Med3D →

04

81.17%VQA 准确率(TCGA)

18/22最优评测任务数

176KVQA 训练样本

临床 AI 系统

全切片病理智能:SlideChat 与临床 AI 的未来

SlideChat 是首个能够理解 Gigapixel 全切片病理图像的视觉语言助手。在 SlideInstruction

(4.2K WSI 描述 + 176K 视觉问答对)上训练,在 SlideBench 22 个任务中 18 个达到最优,

SlideBench-VQA(TCGA)准确率 81.17%,超越第二名 13.47 个百分点。论文已被 CVPR 2025 接收。

SlideChat(CVPR 2025)

SlideInstruction

SlideBench

全切片图像理解

探索 SlideChat →

05

14亿参数(STU-Net-H)

90.06%平均 DSC

104解剖类别

医学图像分割

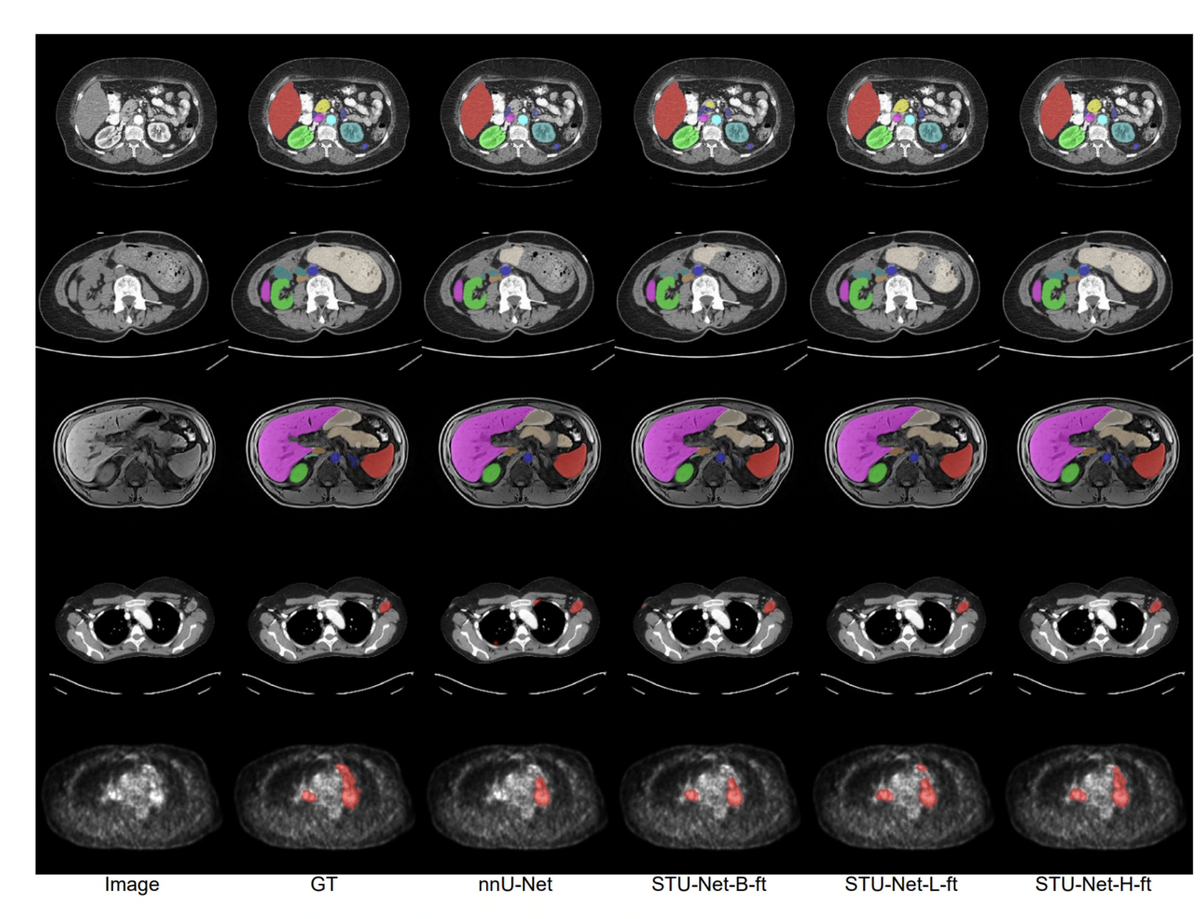

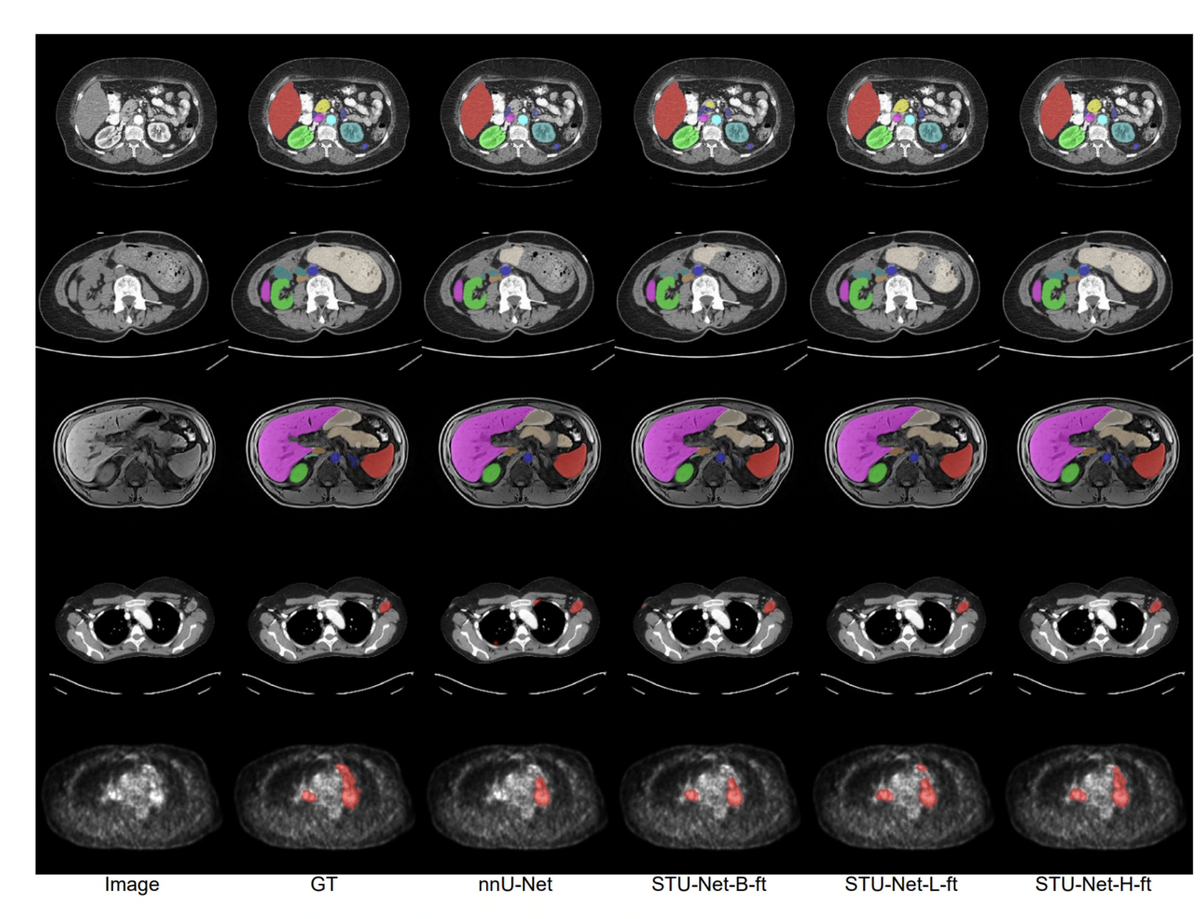

医学影像中的规模扩展定律:STU-Net 从 1400 万到 14 亿参数

STU-Net 在三维医学图像分割领域验证了规模扩展定律。S(1400万)、B(5800万)、

L(4.4亿)、H(14亿)四档模型均基于 TotalSegmentator(1,204 个 CT 体积、104 个

解剖类别)预训练。STU-Net-H 以 90.06% 平均 DSC 刷新基准纪录,超越 nnU-Net 3.3

个百分点及所有 Transformer 方法。最关键的发现:14 亿参数的单一通用模型性能超越

五个专科模型集成——迈出了迈向医学分割基础模型的决定性一步。

STU-Net-H(14亿)

TotalSegmentator

MICCAI 2023 冠军

迁移学习

探索 STU-Net →

学术产出

近期论文

arXiv · 2025

MedQ-Deg: A Multidimensional Benchmark for Evaluating MLLMs Across Medical Image Quality Degradations

arXiv · 2025

UniMedVL: Unifying Medical Multimodal Understanding and Generation through Observation-Knowledge-Analysis

动态

最新动态

MedQ-Deg released — benchmarking MLLM robustness under medical image degradations

UniMedVL: First unified model for medical image understanding and generation

MedQ-Bench: New benchmark for medical image quality assessment in MLLMs

Welcoming new visiting researchers to GMAI Lab

加入我们

共建通用医学智能

我们是上海人工智能实验室的研究团队,致力于实现通用医学智能(General Medical

Intelligence)——能够理解、推理并服务于全谱系临床与生物医学任务的 AI。我们与全球顶尖高校和

医院深度合作。如果你认同这一愿景,我们有开放岗位,欢迎联系。