学术产出

论文成果

arXiv · 2025

MedQ-Deg: A Multidimensional Benchmark for Evaluating MLLMs Across Medical Image Quality Degradations

我们提出MedQ-Deg,一个用于评估医学多模态大语言模型(MLLM)在临床真实图像质量退化条件下 表现的综合性基准。MedQ-Deg涵盖18种退化类型、30个细粒度能力维度和7种影像模态,共24,894个 问答对。我们引入校准偏移(Calibration Shift)指标来量化模型置信度与实际性能之间的差距, 揭示了"AI邓宁-克鲁格效应"——模型在准确率严重下降的情况下仍维持不恰当的高置信度。对40个 主流MLLM的评估表明,模型性能随退化程度的增加而系统性下降。

arXiv · 2025

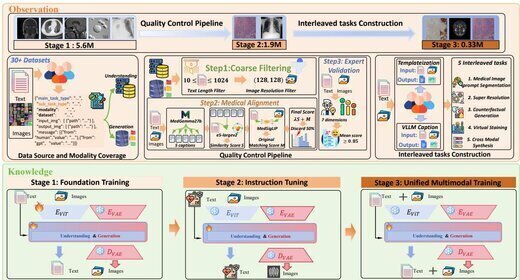

UniMedVL: Unifying Medical Multimodal Understanding and Generation through Observation-Knowledge-Analysis

我们提出UniMedVL,这是首个在单一架构内统一图像理解与生成能力的医学多模态模型,无需手动切换 模型检查点。基于"观察-知识-分析"(OKA)框架,我们构建了包含560万余条多模态医学样本的 UniMed-5M数据集,并设计了渐进式课程学习策略以系统性地构建模型能力。UniMedVL在5个医学图像 理解基准上取得了优异表现,同时在8种影像模态的生成质量上与专用模型持平,证明了双向知识共享 能够同时提升理解和生成性能。

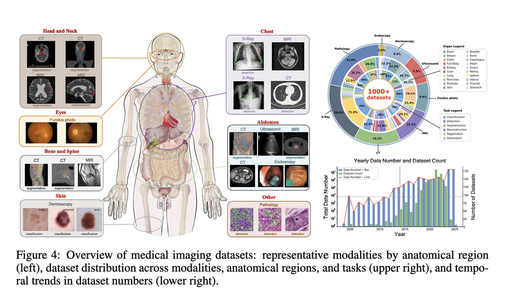

arXiv · 2026

Project Imaging-X: A Survey of 1000+ Open-Access Medical Imaging Datasets for Foundation Model Development

整合1000+开放医学影像数据集的综合调研与开源平台。我们提出元数据驱动融合范式(MDFP), 将碎片化小数据集整合为大规模、连贯的数据资源,并构建交互式发现门户实现端到端自动化数据集整合。

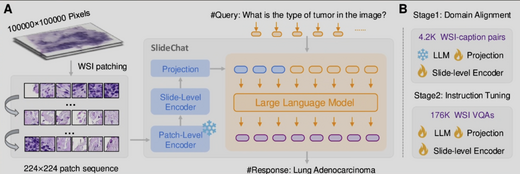

CVPR · 2025

SlideChat: A Large Vision-Language Assistant for Whole-Slide Pathology Image Understanding

我们提出SlideChat,这是首个能够理解吉像素全切片图像(WSI)的视觉语言助手。 我们构建了SlideInstruction——一个包含4,181对切片-报告对及175,753个问答对的数据集, 涵盖13个病理类别,规模比现有数据集大20倍。SlideChat在SlideBench-VQA(TCGA)上 达到81.17%的准确率,并在22项任务中的18项上超越了最先进的结果,为下一代医学 视觉语言模型建立了数据-模型-基准框架。

MICCAI · 2025

· Oral

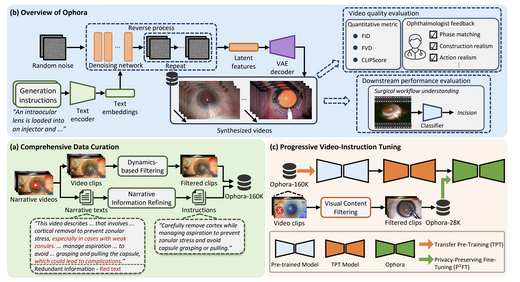

Ophora: A Large-Scale Data-Driven Text-Guided Ophthalmic Surgical Video Generation Model

我们提出Ophora,一种基于文本引导的手术视频生成模型,该模型在Ophora-160K (16万个视频-文本对)上进行训练。通过利用基于LVLM的帧过滤的隐私保护微调流程, 生成了Ophora-28K子集。Ophora在FID、FVD和CLIPScore等指标上均优于现有方法, 且合成视频显著提升了下游手术工作流理解性能(例如,MViTv2 Top-1准确率从 37.92%提升至42.24%)。

MICCAI · 2025

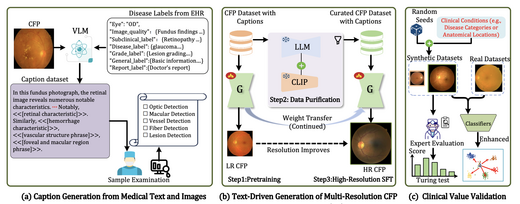

RetinaLogos: Fine-Grained Synthesis of High-Resolution Retinal Images Through Captions

RetinaLogos针对标注视网膜图像长期短缺的问题,通过以自由形式自然语言为条件 生成高分辨率眼底照片来解决这一挑战。我们构建了RetinaLogos-1400k(包含1400万 张图像-文本对),并训练了一个在1024×1024分辨率下运行的三阶段渐进式生成流程。 专家盲评结果显示,62.07%的合成图像被判断为真实图像。糖尿病视网膜病变(DR) 分级准确率提升5–10%,青光眼检测F1值达到0.93。

MICCAI · 2025

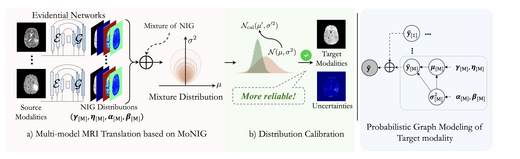

Multi-modal MRI Translation via Evidential Regression and Distribution Calibration

我们提出一种新颖的磁共振成像跨模态转换框架,将证据回归(Evidential Regression) 与分布校准(Distribution Calibration)相结合,以解决临床场景中缺失模态序列的问题。 每种源模态预测一个Normal-Inverse Gamma分布,并通过MoNIG进行融合,实现不确定性 感知的图像合成。在BraTS2023及低磁场非洲磁共振成像数据集上的验证结果表明, 该框架在跨中心泛化任务中达到PSNR 28.48 dB、UCE 0.089的性能水平。

CVPR · 2025

Interactive Medical Image Segmentation: A Benchmark Dataset and Baseline

我们提出IMIS-Bench,一个全面的交互式医学图像分割基准测试,包含超过3.61亿个掩码, 涵盖多种影像模态。我们提出了面向医学领域交互式分割的基线方法和评估协议, 为临床应用中可提示分割方法的比较建立了标准框架。

arXiv · 2025

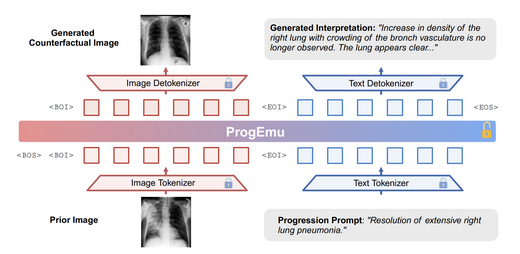

MedITok: A Unified Tokenizer for Medical Image Synthesis and Interpretation

MedITok是首个面向医学图像设计的统一视觉标记器,旨在解决联合合成与理解任务 中结构保真度与语义丰富性之间的矛盾。其采用两阶段训练框架:第一阶段在30M+ 无标注图像上进行预训练以实现视觉对齐,第二阶段在200万图文对上进行微调以 实现语义对齐。MedITok在涵盖9种成像模态、30余个数据集的重建、分类、生成 及视觉问答任务中均达到当前最优水平。

ICCV · 2025

OphCLIP: Hierarchical Retrieval-Augmented Learning for Ophthalmic Surgical Video-Language Pretraining

OphCLIP是一种层次化检索增强的视觉-语言预训练框架,专为眼科手术工作流程 理解而设计。该框架基于OphVL构建——OphVL是一个大规模数据集,包含375,000余个 层次化结构的视频-文本对,涵盖手术阶段、手术器械及临床结局等信息——OphCLIP 可同时学习细粒度与长时序的视觉表征。在11个数据集上针对手术阶段识别与多器械 检测任务的评估结果表明,该框架具备强健的泛化能力与优越的综合性能。

arXiv · 2024

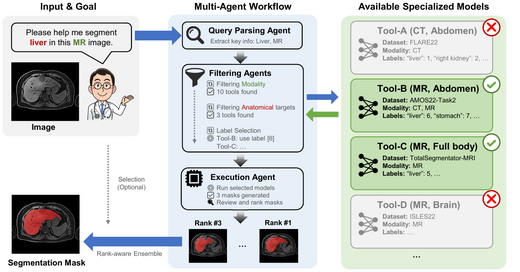

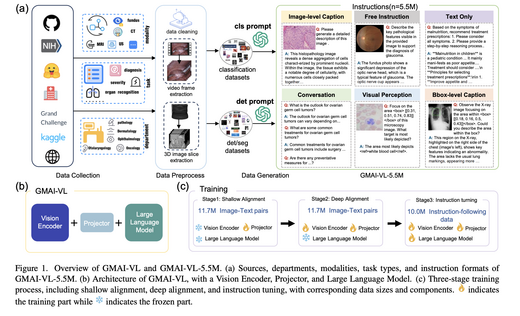

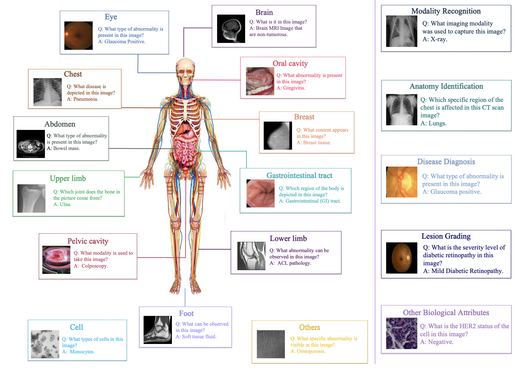

GMAI-VL & GMAI-VL-5.5M: A Large Vision-Language Model and A Comprehensive Multimodal Dataset Towards General Medical AI

GMAI-VL是一个通用医学视觉语言模型,基于GMAI-VL-5.5M进行训练——该数据集 汇聚了数百个专科医学子数据集,统一构建为550万高质量图文对,涵盖18个临床 专科和10余种影像模态。模型采用三阶段训练策略,逐步强化视觉与语言的对齐 与融合能力。GMAI-VL在多个医学多模态视觉问答与诊断推理基准测试上达到或 超越了当前最优水平。

NeurIPS · 2024

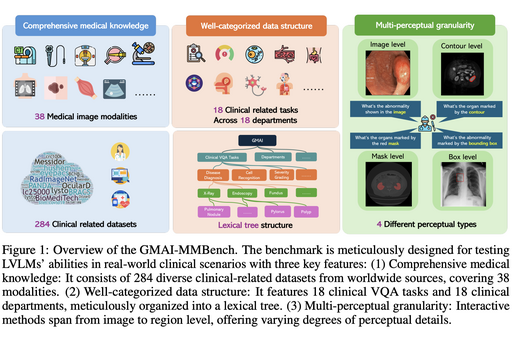

GMAI-MMBench: A Comprehensive Multimodal Evaluation Benchmark Towards General Medical AI

GMAI-MMBench是目前最全面的通用医学人工智能评测平台,覆盖284个数据集、 38种影像模态、18项临床任务、18个临床科室以及4级感知粒度,并配备层次化 任务分类体系。对50个大型视觉语言模型的评测结果表明,即便是表现最优的 模型(如GPT-4o)准确率也仅达53.96%,这一结果量化了医学多模态理解的 挑战难度,并揭示了当前前沿模型存在的五类常见失效模式。

MICCAI · 2024

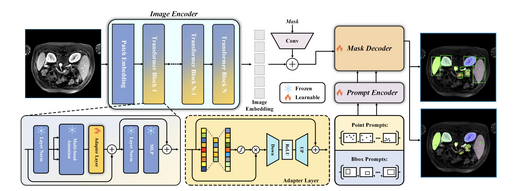

SAM-Med3D-MoE: Towards a Non-Forgetting Segment Anything Model via Mixture of Experts for 3D Medical Image Segmentation

SAM-Med3D-MoE通过混合专家架构扩展SAM-Med3D,以解决任务特定微调过程中的灾难性遗忘问题。 通过将不同的医学影像任务路由至专门的专家模块,该模型在保持通用分割能力的同时, 在多个3D医学影像基准上实现了强大的任务特定性能。

IEEE TNNLS · 2025

· ECCV 2024 Workshop Oral

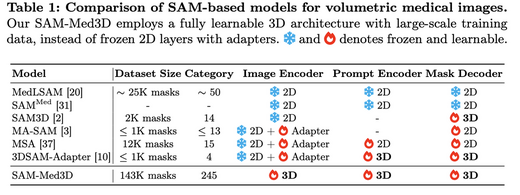

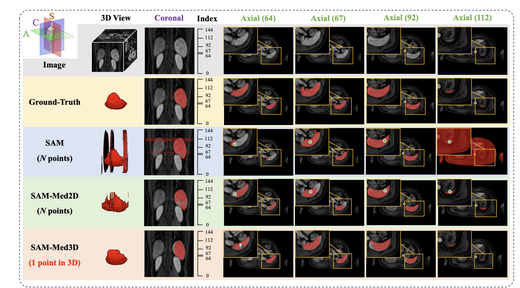

SAM-Med3D: Towards General-purpose Segmentation Models for Volumetric Medical Images

SAM-Med3D将Segment Anything Model(SAM)适配至三维体积医学图像领域。我们 构建了一个包含21K个医学体积数据和131K个三维掩码的大规模三维数据集,涵盖 247个类别,并在此基础上训练SAM-Med3D以在体素级别建模三维上下文信息。 SAM-Med3D相较于基于二维切片的方法,在分割精度与鲁棒性方面取得了显著提升, 为临床应用与科学研究提供了一个支持通用提示的分割骨干网络。

arXiv · 2023

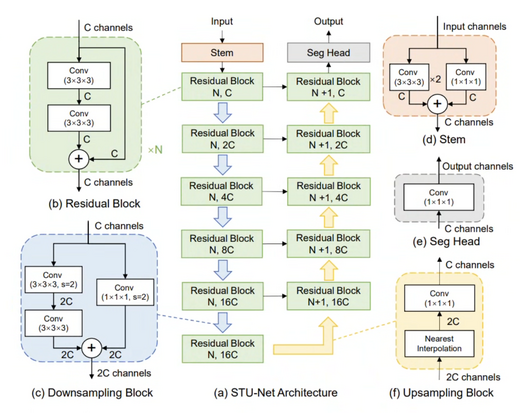

STU-Net: Scalable and Transferable Medical Image Segmentation Models Empowered by Large-Scale Supervised Pre-training

STU-Net是一系列可扩展、可迁移的U-Net模型,经大规模标注医学图像分割数据集 预训练而成。其参数规模从14M延伸至1.4B,其中STU-Net-H(参数量达1.4B)是 迄今为止规模最大的医学图像分割模型。经过大规模有监督预训练后,各规模模型 在直接推理与微调两种设置下均取得了优异性能,充分验证了其强大的可扩展性 与迁移能力。